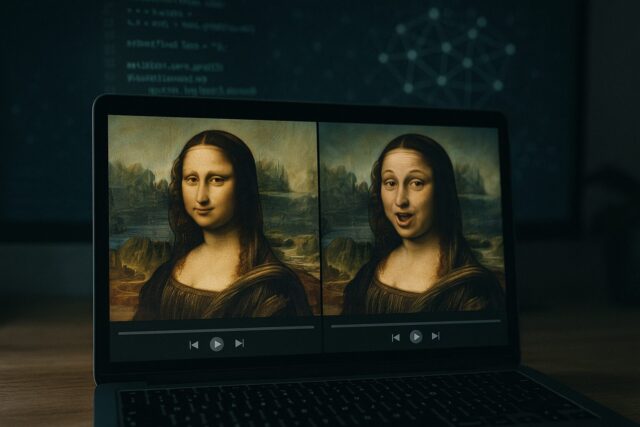

La inteligencia artificial ha traído avances increíbles en muchos aspectos de nuestra vida: desde la medicina y el entretenimiento hasta las casas inteligentes. Pero también tiene un lado oscuro. Una de sus manifestaciones más preocupantes son los deepfakes: videos y audios manipulados digitalmente que imitan la apariencia o la voz de una persona real, con una precisión sorprendente.

En esta guía te explicamos qué son los deepfakes, cómo se crean, por qué representan una amenaza creciente, cómo detectarlos y, sobre todo, cómo protegerte de ellos tanto a nivel personal como profesional.

¿Qué es un deepfake?

El término «deepfake» combina «deep learning» (aprendizaje profundo) y «fake» (falso). Hace referencia a contenidos audiovisuales manipulados mediante inteligencia artificial, que simulan la voz o el rostro de una persona real de forma extremadamente realista.

Estos videos pueden hacer que alguien diga o haga algo que nunca ocurrió. Políticos, celebridades, empresarios y personas comunes han sido víctimas de esta tecnología.

¿Cómo se crean los deepfakes?

Los deepfakes se crean utilizando algoritmos avanzados, principalmente redes neuronales generativas (GAN). Aunque el proceso requiere entrenamiento computacional, hoy existen herramientas accesibles que permiten crear deepfakes con pocos conocimientos técnicos.

Fases típicas de creación:

-

Recolección de datos

Se recopilan imágenes, videos y audios de la persona objetivo para que el sistema aprenda sus gestos, tono de voz, expresiones faciales y movimientos. -

Entrenamiento del modelo IA

El sistema se entrena para replicar el rostro o la voz en diferentes situaciones. -

Montaje y superposición

La cara o la voz se inserta sobre otro cuerpo o video preexistente. -

Ajustes finales

Se sincronizan los labios, se mejora la iluminación y se optimiza el audio para lograr un resultado creíble.

¿Por qué son peligrosos los deepfakes?

Difusión de desinformación

Un deepfake puede hacer que una figura pública emita declaraciones falsas, afectando elecciones, conflictos sociales o decisiones económicas.

Daño a la reputación y chantaje

Personas comunes han sido víctimas de montajes pornográficos o violentos utilizando sus rostros, lo que en algunos casos ha derivado en extorsión o humillación pública.

Fraudes financieros

Ya se han registrado casos donde se imitó la voz de un ejecutivo para autorizar transferencias bancarias fraudulentas, engañando a empleados reales.

Pérdida de confianza en lo digital

Si no podemos confiar en lo que vemos u oímos en Internet, se erosiona la credibilidad de los medios y de los contenidos auténticos.

¿Cómo detectar un deepfake?

Aunque cada vez son más realistas, muchos deepfakes aún presentan fallos sutiles. Aquí algunas señales a tener en cuenta:

Indicadores visuales

-

Parpadeo poco natural o mirada fija

-

Diferencias de tono de piel entre el rostro y el cuello

-

Movimientos labiales desincronizados

-

Distorsiones o «glitches» alrededor de la cara

-

Iluminación o sombras mal ajustadas

Señales auditivas

-

Voz metálica, robotizada o con ritmo extraño

-

Desfase entre audio e imagen

-

Ruidos digitales, eco o cortes

Pistas contextuales

-

El contenido no concuerda con lo que esa persona suele decir o hacer

-

La fuente es dudosa o no verificable

-

El video se vuelve viral desde sitios desconocidos

Si algo te genera duda, no lo compartas sin verificar primero.

Herramientas tecnológicas para detectar deepfakes

Detectores basados en IA

Varias empresas están desarrollando soluciones que analizan automáticamente los contenidos:

-

Microsoft Video Authenticator: asigna un puntaje de autenticidad al video.

-

Deepware Scanner: app móvil para detectar manipulación audiovisual.

-

Herramientas de Meta (Facebook, Instagram): sistemas propios que identifican contenido manipulado.

Blockchain y trazabilidad

Se están implementando métodos para registrar la «huella digital» de archivos auténticos en blockchain, lo que permite verificar si un contenido fue alterado.

Certificación de autenticidad

La Content Authenticity Initiative (de Adobe, Reuters y otros) busca añadir metadatos a cada archivo multimedia: origen, dispositivo, fecha y ediciones.

Consejos para protegerte de los deepfakes

Verifica antes de compartir

-

Asegúrate de que la fuente sea confiable y conocida.

-

Los videos diseñados para generar ira o miedo suelen tener fines manipulativos.

Protege tu imagen y privacidad

-

Cuanto más material audiovisual tuyo circula en línea, más fácil es crear un deepfake con tu rostro o voz.

-

Configura tus redes sociales para limitar el acceso público.

Usa apps de detección

Herramientas como Sensity, Truepic o Deepware te permiten analizar el contenido sospechoso antes de interactuar con él.

Añade marcas de agua y metadatos a tus propios videos

Si creas contenido original, incluye alguna firma digital o marca sutil que permita confirmar su autenticidad.

Sé consciente de la manipulación emocional

Si un video te provoca una reacción visceral (miedo, indignación, tristeza), detente. Respira. Verifica antes de compartir.

¿Qué dice la ley?

La legislación está comenzando a adaptarse:

En Europa y España

-

El Reglamento de Servicios Digitales (DSA) exige a las plataformas marcar el contenido manipulado.

-

Existen marcos legales contra la suplantación de identidad, difamación y violación de la intimidad.

En otros países

-

Estados Unidos: algunos estados han prohibido el uso político de deepfakes en época electoral.

-

Reino Unido: se debaten leyes específicas contra deepfakes sexuales no consentidos.

Las víctimas pueden solicitar la eliminación del contenido, emprender acciones legales y, en algunos casos, recibir compensación.

¿Qué nos espera en el futuro?

Los deepfakes en tiempo real ya existen. Pronto podrán usarse durante videollamadas, transmisiones en vivo o entrevistas.

La única defensa real es una combinación de:

-

Tecnología: mejores sistemas de detección y verificación

-

Leyes claras: que castiguen el uso malicioso

-

Conciencia social: educación digital desde la infancia

En un mundo donde lo falso puede parecer más real que la verdad, la alfabetización digital será tan importante como saber leer y escribir.

Las imágenes utilizadas en este artículo son generadas por IA o provienen de plataformas libres de derechos como Pixabay o Pexels.

¿Te gustó este artículo? ¡Invítame a un café!